资讯

Notion联手国产AI推出开源模型 重塑工作流主打性价比

Notion宣布引入首个开源权重模型MiniMax M2.5,打破闭源模型垄断,为全球用户提供高性价比AI选择。该模型针对智能体工作流优化,在文档处理、任务自动化等场景中表现卓越,成本远低于闭源模型,标志着国产大模型进入全球主流生产力工具核心。

DeepSeek V4即将发布 多模态模型或重塑AI格局

DeepSeek即将发布全新多模态模型V4,具备图像、视频和文本生成能力,并全面支持国产算力。同时推出的V4 Lite测试版拥有2000亿参数和100万tokens上下文窗口,原生多模态架构显著提升处理能力。这一系列技术突破将加速AI与本土芯片的融合,为人工智能领域带来新的发展动力。

再携手!清华陈建宇×斯坦福Chelsea团队发布VLAW,世界模型×VLA协同进化

清华陈建宇团队与斯坦福Chelsea Finn团队联合发布VLAW框架,首次实现视觉语言动作策略与世界模型的协同进化。该框架通过真实交互数据提升世界模型的物理保真度,同时利用高质量虚拟数据强化VLA策略,解决了现有世界模型盲目乐观和物理模拟不准确的难题,为具身智能的发展提供了新思路。

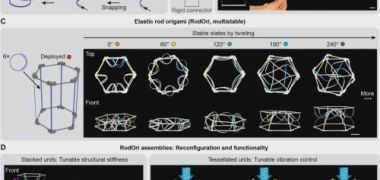

浙大团队突破低压DEAs人造肌肉技术 解决介电弹性体高压瓶颈

浙江大学团队在《Science Robotics》发表突破性研究,成功开发出低压高输出介电弹性体执行器(LVHO-DEA),仅需200伏电压即可驱动,解决了传统介电弹性体人造肌肉需要千伏高压的难题。该技术通过材料创新和工艺优化,实现了超越自然肌肉的能量密度和功率密度,并应用于无系绳软体机器人,为可穿戴设备和柔性机器人领域带来重要进展。

DeepSeek V4即将发布 多模态模型提升AI智能生成

DeepSeek即将发布全新的多模态大语言模型V4,原生支持图片、视频和文本的AI生成能力。该模型不仅填补了国内低成本开源模型的市场空白,还通过与华为、寒武纪合作进行硬件优化,推动本土半导体发展。V4的发布将极大拓展AI在创作、广告和教育等领域的应用潜力,助力中国在全球AI领域的竞争力提升。

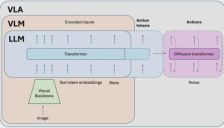

人形机器人智能大脑进化路径

文章深入探讨了人形机器人“大脑”即核心AI模型的演进路径,分析了当前主流的视觉语言动作模型的优势与局限,并揭示了数据稀缺与边缘算力不足两大核心挑战。报告指出,产业正通过提升仿真质量、建设数据工厂、融合跨本体数据等多重策略寻求突破,并预测未来竞争将演变为一场规模游戏,结构性优势将决定企业间的差距。

谷歌发布Nano Banana 2图像AI模型 告别中文乱码 画质直达4K

谷歌发布新一代图像生成模型Nano Banana2,基于Gemini3.1Flash Image架构,显著提升理解能力和响应速度。该模型重点修复了中文字符乱码、语义混乱等顽疾,支持生成清晰中文文本,画质从2K提升至4K,增强角色一致性和复杂场景处理能力,将整合至Gemini、Google AI Studio等多款产品中。

大模型赋能化工厂安全 AI技术重构防护体系登顶刊

微筑科技联合产学研团队在权威期刊EAAI发表基于扩散模型的化工安全智能监控框架研究。该技术通过AI生成训练数据,结合多模态模型与先进检测算法,精准识别工人危险行为与环境隐患,检测准确率最高达98.1%,有效解决化工安全监控中数据稀缺与误判难题,为工业安全生产提供智能化解决方案。

英伟达发布SONIC模型 人形机器人动作更拟人

英伟达SONIC框架通过700小时人体动作数据训练和4200万参数模型,实现了人形机器人的通用控制。该技术突破传统单一动作训练模式,支持跑步、跳跃、拳击等全场景自然动作,并能通过视频、文本、音乐等多种模态进行跨模态控制,无需重复训练即可灵活响应。

仅需0.73秒!Unitree G1机器人随指令起舞打太极

本文介绍了TextOp框架如何实现人形机器人通过文本指令实时控制运动的技术突破。该系统允许用户在机器人执行动作过程中随时输入新命令,实现平滑过渡,平均响应时间仅0.73秒。文章详细解析了其双级协作架构、实测性能数据以及广泛的应用场景,展示了从实验室到实际落地的潜力。

无腿机器人突破两栖极限 跳跃游泳负重40倍体重

哈工大研究团队在《Science Advances》发表突破性成果,成功研制出纯惯性驱动的无腿两栖机器人Leglessbot。该机器人采用全密封刚性外壳和单一驱动器,无需外露运动部件即可实现跳跃、奔跑和游泳多模态运动。在沙地上速度可达1.4倍体长每秒,负载能力高达40倍自重,水中通过被动鳍片实现灵活转向。这一设计为厘米级机器人在恶劣环境下的应用提供了全新解决方案。

北大团队在芯片领域实现1纳米功耗最低突破

北京大学电子学院邱晨光-彭练矛团队在非易失性存储器领域取得重大突破,成功研制出物理栅长仅1纳米、工作电压低至0.6V的铁电晶体管,能耗降至0.45 fJ/μm,为国际上尺寸最小、功耗最低的铁电晶体管。该成果有望解决AI芯片中逻辑与存储电压不匹配的瓶颈,提升算力和能效,相关研究发表于《科学·进展》。

VLA技术路线能否成功?

本文探讨了视觉语言动作模型(VLA)在机器人领域的发展前景与挑战。文章分析了VLA面临的核心问题,包括机器人数据采集的规模限制、仿真与现实的差距、暴力堆参数方法的局限性,以及VLA与成熟视觉语言模型(VLM)在输出空间、反馈机制和时序依赖上的本质差异。通过深入剖析数据鸿沟、物理因果需求和技术瓶颈,引发了对VLA技术路线可行性的关键思考。

KAIST与UC Berkeley团队为VLA模型赋予记忆 实测成功率提升一倍

KAIST和UC Berkeley团队提出的HAMLET框架为视觉-语言-动作模型添加了历史记忆能力,解决了机器人在长时任务中因缺乏上下文而失败的问题。该轻量级插件通过时刻令牌和记忆模块整合关键历史信息,无需从头训练大模型,即在真实场景任务中将成功率提升高达47.2%,同时保持高效推理速度。

京东发布 JoyAI-LLM-Flash 大模型,引领AI技术突破

京东于2月14日在Hugging Face平台开源了其最新大模型JoyAI-LLM-Flash,该模型总参数48亿,采用混合专家架构,支持128K上下文长度。通过创新的FiberPO优化框架和Muon优化器,解决了模型扩展的不稳定问题,提升了训练效率和应用潜力,展现了在知识理解、推理和编程方面的卓越能力。