AI产业正从参数竞赛走向“兑现真实能力”的关键阶段。随着Agent应用、长文档理解、多轮复杂交互快速普及,大模型落地的核心命题已从“能不能训出来”转向“能不能高效跑起来”。在推理环节,“Attention”成为制约长上下文性能的核心瓶颈,直接决定部署成本、响应速度与用户体验,更关乎AI算力能否承接长上下文、长链条推理与Agent协同等新一代需求。

长上下文普及之下,Attention量化成为行业新战场。与Linear层相比,Attention路径更长、数值波动更大、对数据流高度敏感,传统量化方案难以兼顾“精度保留、动态范围、工程简洁”三大目标:要么在复杂分布下精度塌陷,要么依赖细粒度量化抬升工程成本,要么无法在真实业务中释放硬件算力。Attention量化长期被视作大模型高性能推理的“卡脖子难题”,谁率先突破,谁就能掌握长上下文时代的推理主动权。

在此背景下,“HiFloat8(HiF8)”给出面向长上下文Attention的全新解法,不止是一次8-bit优化,更是针对AI算力与大模型推理瓶颈的底层突破。

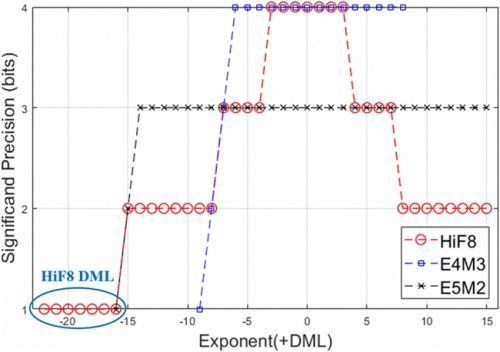

图一:有效精度 VS 指数值:HiF8锥形精度示意图

不同于传统FP8固定划分指数与尾数位,HiF8采用适配Attention数据特征的“动态精度分配”设计,呈现独特锥形精度分布:在数值高概率区间保留充足精度,在分布两端覆盖更大动态范围,不显著增加数据流复杂度,即可将8-bit量化真正落地到Attention这条最关键、最敏感的推理链路。

这一创新的价值远超单点技术优化。过去AI基础设施聚焦模型适配、框架兼容与生态建设,而HiF8直指更底层的核心瓶颈:“不被动适配已有模型,而是主动破解推理关键痛点”,标志AI算力与基础软件从“能支撑”迈向“能优化、能突破”的全新阶段。

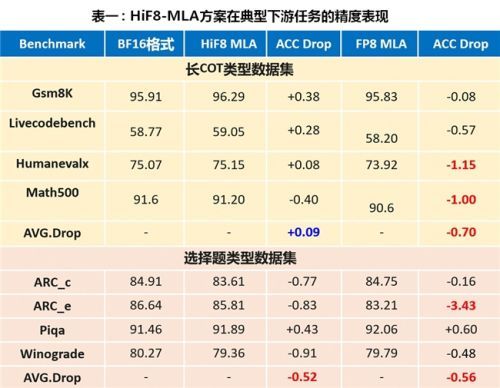

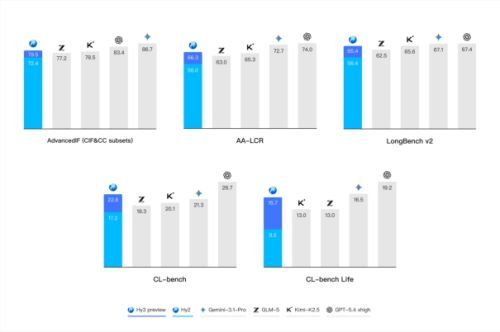

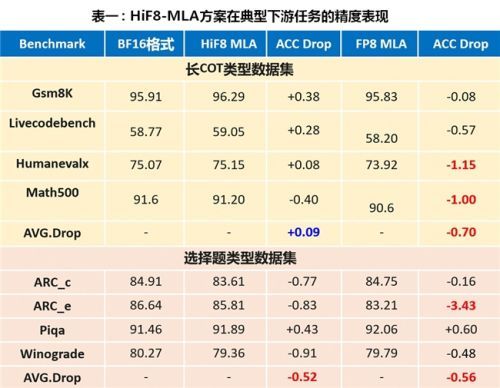

实测数据印证HiF8的“精度与性能双优”,真正实现精度与性能不必二选一。在LongCat模型典型下游任务中,HiF8 Attention量化保持高效数据流,整体精度与BF16基线基本持平;长CoT任务稳定性优于参考FP8方案;最长输入达“128K”的LongBench v2测试中,精度表现依然稳健。

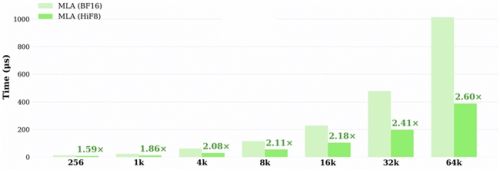

性能收益随上下文长度增长持续放大。基于昇腾950实测:LongCat-560B模型端到端加速比从“1.59倍”提升至“2.60倍”;DeepSeek v3.1模型从“1.52倍”提升至“2.65倍”。输入越长,HiF8优势越显著,完美匹配长上下文、复杂推理与Agent应用的产业趋势。

图二:LongCat-560B HiF8量化方案相对于BF16的加速比

图三:Deepseek-v3.1 HiF8量化方案相对于BF16的加速比

从行业视角看,HiF8的意义远不止局部优化。它回应了大模型规模化落地的核心命题:模型能力持续跃升后,底层推理系统能否同步进化,在成本、时延、精度、工程效率间达成新平衡。唯有突破这一环,大模型才能从实验室、榜单走向大规模企业部署与行业落地。

Attention量化的突破,是AI技术体系向深处生长的缩影。当前算力竞争已超越“有无”层面,进入“把关键底层问题做透”的新阶段。HiFloat8在长上下文Attention量化的创新,为大模型高性能推理补上关键拼图,为AI算力突破打开新空间,助力中国AI在长上下文时代筑牢创新底座。