资讯

研究人员推出LPM1.0模型,实现单图转实时交互式数字人视频

LPM1.0模型实现了通过单张参考图像生成实时交互式数字人视频。该模型支持多模态输入,具备精准唇形同步与自然情绪表达,可与ChatGPT等AI集成实现实时视觉对话。凭借核心技术,它能即时驱动多种风格角色且无需二次训练。该研究标志着AI交互正向具备情感响应与视觉具身化的全维度形态演进,具有重要的科研价值。

华为昇腾0Day支持MiniMax M2.7,开启模型自我进化时代

本文介绍了华为昇腾AI基础软硬件实现对MiniMax首个自我深度迭代模型M2.7的0Day同步支持。MiniMax M2.7具备强大的Agentic能力,能通过自我循环实现研发工作流自动化,在编程和专业办公领域表现优异。华为昇腾通过通信加速和算子融合等技术优化,消除了算力瓶颈,为该“自我进化”模型的落地应用提供了坚实的国产算力底座支持。

阿里通义 CoPaw 官宣更名为 QwenPaw:深度整合“千问”生态,桌面 Agent 开启进化新阶段

开源桌面Agent工具CoPaw发布1.1.0并更名为QwenPaw,正式纳入通义千问开源生态。文章梳理其品牌愿景与优势:全平台接入、支持本地/云端一键部署与自由接入本地模型,并展望端云结合、大小模型协同、安全机制升级及多智能体协作的演进方向。

Cyborg and Bionic Systems:面向工具操作的触觉肌电假肢动态操作技能学习

本文介绍了北邮联合清华、武科大团队在SCI1区期刊发表的触觉肌电假肢研究成果,针对工具操作动态场景提出融合多模态信号的TKE-BGC仿生控制框架,可有效降低冲击导致的抓握失稳风险,提升假肢操作稳定性与效率,为截肢患者提升生活独立性、重返职场提供技术支撑。

国产Agent生态加速发展:小米MiMo-V2接入顶级框架Hermes,推出14天限时免费体验

小米宣布自研大模型 Xiaomi MiMo-V2 系列正式接入顶级开源 Agent 框架 Hermes Agent,开发者更新至最新版即可在 Nous Portal 调用 MiMo-V2Pro/Omni/Flash 三款模型。文章解析其 1M 长上下文、全模态感知与原生工具调用优势,并介绍 4/8-4/22 两周不限量限免政策与生态意义。

腾讯发布HY-Embodied-0.5具身模型:22项评测中16项最佳刷新行业纪录

腾讯Robotics X与混元团队发布具身基础模型HY-Embodied-0.5,面向机器人三维感知与物理交互痛点重构架构与训练范式,推出MoT-2B与MoE-32B两款模型。依托超1亿条具身数据及多阶段后训练,22项评测16项夺冠,并在实机打包、堆叠等任务中优于主流基线,推动大模型落地物理世界。

阿里黑科技炸场!0.6B 小模型“魔改”成 17B MoE,激活参数仅 5%,CPU 直接跑 30token/s!

本文介绍阿里国际数字商业团队推出的Marco-Mini-Instruct MoE模型,该模型通过Upcycling技术由0.6B小模型升级为17B总参数规模,激活参数仅5%,CPU上可实现30token/s的推理速度,性能超越4B级Dense模型,为行业提供了低成本、高效率的MoE炼制新路径,大幅降低中小团队落地MoE的门槛。

Anthropic 重磅发布“顾问工具”!Sonnet/Haiku 干活,Opus 只当幕后军师

本文介绍Anthropic最新推出的Claude顾问工具,该功能采用小模型执行任务、大模型仅在复杂决策节点提供指导的混合模式,经实测可同时实现性能提升与成本下降,开发者仅需简单配置即可启用,为AI Agent开发提供了高性价比的全新方案。

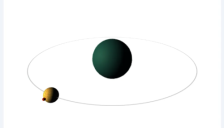

交互升级:Google Gemini 支持生成 3D 模型与物理模拟场景

Google 近日为其 AI 助手Gemini推出了重磅更新。现在,当用户询问涉及空间结构或物理规律的问题时,Gemini 不再仅仅提供文字和图片,而是能直接生成可旋转、可缩放的交互式 3D 模型及动态模拟场景。这项新功能允许用户通过直观的可视化手段理解复杂概念。例如,用户可以要求 Gemini 演示“月球绕地公转”或“双摆系统”。系统会生成一个三维场景,用户可以通过滑块调节变量(如运动速度、重力...

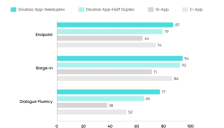

字节跳动发布原生全双工语音大模型Seeduplex:懂倾听、抗干扰

本文介绍字节跳动4月9日发布的原生全双工语音大模型Seeduplex,其突破“边听边说”同步处理框架,抗干扰能力提升,误回复率、误打断率降50%,判停延迟缩短,已在豆包App全量上线,推动AI语音交互向实时自然交互演进,为多模态交互行业发展提供新方向。

Meta发布Muse Spark个人超级智能模型:算力节省10倍 经千人医生训练 支持拍照识别数独、可提供专业级健康咨询服务

Meta正式发布Muse系列首款个人超级智能模型Muse Spark。该模型采用原生多模态架构,算力效率较Llama4Maverick提升10倍。Muse Spark凭借多智能体并行推理与深度视觉能力,可实现拍照出数独等复杂交互,更通过千人医生联合训练提供专业健康建议。目前模型已在Meta.ai及应用端上线,标志着个人AI智能进入低能耗、高专业度的新阶段。

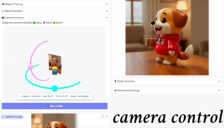

从平面修图到空间重塑:京东开源图像模型JoyAI-Image-Edit重新定义AI编辑

京东探索研究院正式开源JoyAI-Image-Edit图像模型,引领AI修图迈向“空间智能”新阶段。该模型通过深度建模三维空间,实现了对相机视角、物体位移及缩放的精准控制,并全面兼容15类通用编辑需求。其出色的几何一致性与物理规律理解力,为电商生产、创意设计及具身智能等领域提供了强大的底层技术支撑。

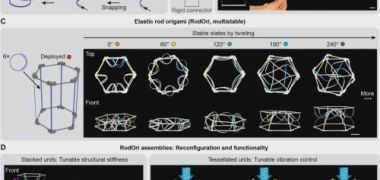

耶鲁大学研发全开源张拉整体机器人 撞不烂摔不碎还能自主走位

本文介绍耶鲁大学与罗格斯大学联合研发的全开源张拉整体机器人,其采用刚性杆+弹性绳索的软结构,具备高抗冲击性,适配斜坡、沙地、草地等复杂地形,通过离线建模+在线重规划的闭环控制实现自主导航,硬件方案完全开源可复现,为具身智能载体的抗损与复杂场景应用提供了新的技术思路。

微软 GitHub 推出跨模型 AI 审查功能 Rubber Duck 助力提升编程效率

微软 GitHub 为其 Copilot CLI 推出了实验性功能 Rubber Duck,引入了创新的跨模型 AI 审查机制。该功能旨在通过结合如 Claude Sonnet 4.6 和 GPT-5.4 等不同 AI 模型,提供“第二意见”审查,有效发现代码中的潜在错误,显著提升编程效率和代码准确性。研究显示,Rubber Duck 能弥补近 75% 的性能差距,尤其在处理复杂任务时表现突出,能识别架构逻辑漏洞和跨文件冲突。它支持主动、被动和用户触发的多种审查模式,让开发者能及时获得多角度反馈,从而提升