“ 从一份半年更新清单,看一个具身原生框架的崛起逻辑。

在深度学习发展史上,PyTorch用动态计算图、模块化设计与极低的上手门槛,终结了早期框架百花齐放却互不兼容的混乱局面,让全球研究者得以在同一套基础设施上快速验证想法、共享成果。

如今,具身智能领域正站在类似的十字路口。VLA技术研发分散化严重,不同团队基于不同框架各自为战;研发流程异常繁琐,算法对比需配置多份实验环境和数据格式;算法复现缺乏公平基准,难以确保每个对比算法调至最优;VLA研发无法从最新VLM受益,大多数VLA往往基于过时的VLM构建。SFT与RL割裂为两条流水线,前沿VLM的红利迟迟无法向物理操作任务传导。

正是洞察到这些深层痛点,原力灵机把Dexbotic从一站式VLA代码库全面升级为具身原生开发框架,并联合RLinf、携手清华大学与无问芯穹,共同开启"打造具身智能时代PyTorch"的征程。

原力灵机联合创始人汪天才表示,“我们期望通过Dexbotic2.0实现VLA+RL学习范式的统一,通过Dexbotic和RLinf的集合,一起去对应大模型时代SFT+RLHF的黄金范式,一起推动整个具身行业的发展,一起解决具身智能的问题”。

•官网:https://dexbotic.com/

•GitHub:https://github.com/Dexmal/dexbotic

•Hugging Face:https://huggingface.co/collections/Dexmal/dexbotic

01.

2.4B参数登顶全球,一个具身原生大模型的"出厂证明"

先从一个结果说起。

今年2月,一个名为DM0的具身智能大模型悄然登顶了权威真机评测基准RoboChallenge的全球榜首——单任务与多任务双项第一,而它的参数量仅为2.4B。

在具身智能领域,这个成绩的含金量不言而喻。RoboChallenge是全球首个具身智能的大规模真机评测平台,考核的不是仿真中的数字指标,而是真实物理世界中的操作成功率。一个2.4B参数的"小"模型能在此称雄,其"智能密度"之高,令人侧目。

但真正值得追问的是:DM0是怎么被训练出来的?

答案指向它背后的具身原生框架——Dexbotic。

DM0是全球首个从零开始训练的具身原生大模型,它在预训练阶段即系统性地混合了操作、导航、全身控制三类核心任务,覆盖了UR、Franka等8种构型迥异的机器人硬件。这种训练策略迫使模型学习底层通用的物理操作逻辑,而非记忆特定硬件参数,从而获得了强大的跨机型泛化能力。此外,DM0创造性地构建了"空间推理思维链",将环境感知、任务理解、运动规划与精细执行串联成闭环,使机器人能够完成诸如"先寻找目标、移开遮挡物、拍照后发送指令"这类需要多步骤空间推理的复合任务。

这一切得以实现的前提是:Dexbotic 提供了从多源数据混训、模块化模型构建到跨机型适配的完整基础设施。DM0的登顶,本质上是Dexbotic框架能力的一次集中兑现。

02.

半年、15+核心Feature、超千位研发者:一份密集到"反常"的更新清单

在开源社区,一个项目的生命力不看发布时的声量,而看发布之后的迭代节奏。

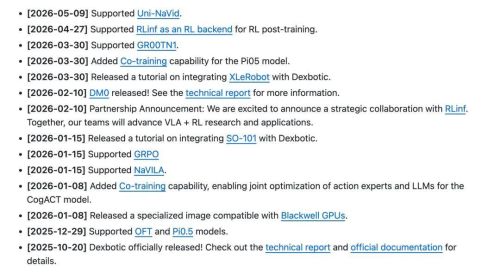

Dexbotic自2025年10月正式开源以来的这份更新清单,密集到几乎可以用"反常"来形容:

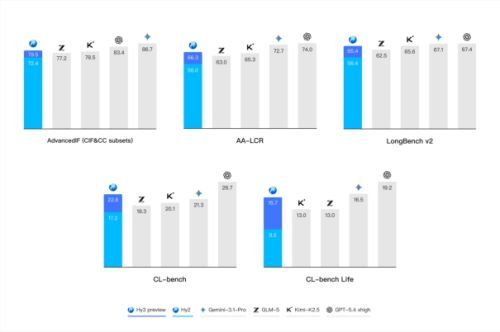

模型层面,先后适配了Pi0.5、OFT、NaVILA、SimpleVLA-RL、GR00T N1等多款前沿模型。其中GR00T N1作为NVIDIA面向通用机器人的基础模型,接入Dexbotic后实测表现强劲——在LIBERO benchmark上平均达到94.8,Spatial任务更达到99.6,从训练到推理链路全面打通。近日又新增了对UniNaVid的全面支持,覆盖评测、SFT训练及DexDataset数据格式适配,将版图从具身操作拓展至VLN/Embodied Navigation方向,打通了导航任务从数据接入、模型微调到Benchmark评测的完整链路。

训练能力层面,CogACT和Pi0.5先后开放了Co-training能力,支持Action Expert与LLM的端到端联合优化,想做端到端联合训练的团队可以直接上手。尤其值得一提的是Pi0.5的多源数据混合训练功能——开发者现在可以直接在Dexbotic上进行"机器人数据+多模态数据"一键混合训练,打破单一数据源的局限,大幅提升模型泛化能力。此外,框架还推出了基于GRPO的轻量级后训练方案:不依赖Ray,部署维护成本更低;支持环境多卡并行推理,rollout过程无需频繁重建环境;训练数据可在多卡之间点对点快速均匀分配,整体训练吞吐显著提升。

硬件生态层面,在最初支持ALOHA、UR5、Franka、ARX5的基础上,陆续接入了SO-101、星海图Galaxea R1、原力灵机自研开源硬件DOS-W1、XLeRobot生态,已适配超过10款主流机型,覆盖从桌面级机械臂到人形机器人的广泛形态。以XLeRobot为例,Dexbotic发布了详尽的集成教程,以"桌面桂圆收集任务"为案例,手把手演示了从数据采集、DexData格式转换、VLA模型训练到部署推理的完整闭环——真正做到了从0到1的具身原生全流程打通。

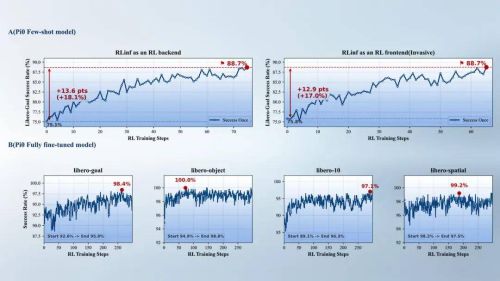

基础设施层面,发布了适配Blackwell GPU架构的专用镜像,新卡用户一行命令即可拉取,新架构即刻可用;发布了SO-101机械臂接入教程,硬件开发者可以直接"抄作业";同时正式支持以RLinf作为分布式强化学习后端,开发者无需在两个仓库间来回跳转,一行命令即可启动完整的RL后训练流程。

截至目前,Dexbotic已服务清华、北大、普林斯顿、帝国理工等数十家知名院校,以及腾讯、北京具身智能机器人创新中心等头部企业,累计触达超千位研发者。

一个自然的问题是:是什么样的技术底座,支撑得起如此高密度的Feature输出?

03.

V-L-A解耦:让具身智能开发真正进入"乐高时代"

答案藏在Dexbotic 2.0的架构重构中。

今年2月,Dexbotic完成了一次质变级的升级——从一站式VLA代码库蜕变为具身原生开发框架。如果说1.0时代的Dexbotic是一个功能齐全的"工具箱",那么2.0则是一套可以自由拼装、独立演进的"积木体系"。

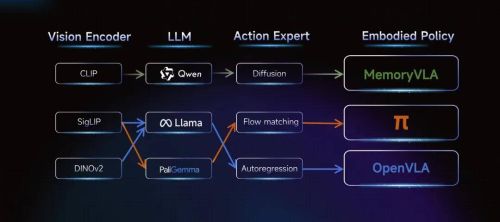

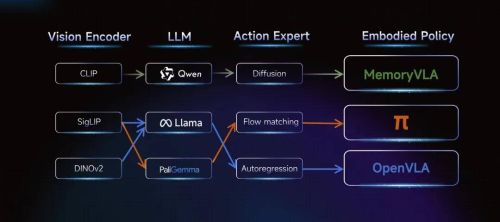

核心突破在于V-L-A模块化解耦。框架在架构层面将Vision Encoder(视觉编码器)、LLM(大语言模型)和Action Expert(动作专家)三大组件彻底拆开,同一套系统可在感知、认知和控制三个层面独立升级、自由替换与灵活混搭。

这意味着,当一个更强的视觉基座模型发布时,研究者只需替换V模块,L和A完全不受影响;当需要适配一款新的机械臂时,只需调整Action Expert,认知与感知层安然无恙。正是这种高度模块化的设计,才使得Dexbotic在半年内密集接入Pi0.5、GR00T N1等多种异构模型时,不至于陷入"牵一发动全身"的工程泥沼。

而在解耦的基础上,Dexbotic 2.0带来了一项更具战略意义的能力——多源数据混合训练。

传统方案中,互联网图文/视频数据和机器人实操轨迹数据分属两条训练管线。Dexbotic 2.0用同一套训练过程把两类数据统一起来:视觉-语言模型同时摄入多模态数据,学习场景描述(Caption)、任务拆解(Subtask)和指令锚定(Grounding)三类核心能力;动作专家在此之上接入,将高维语义理解直接转化为抓取、移动、放置等连续控制序列。两类数据共同优化,使模型既具备通用语义理解,又掌握可落地的操作技能——"能说清、能看准、能做对"。

DM0的跨机型泛化能力与全球榜首的成绩,正是这套多源混训范式的直接产物。

04.

数据—训练—评测—硬件:四环闭合的具身开发全流程

架构解耦解决了"怎么搭"的问题,但具身智能研发中另一个长期痛点在于全流程的碎片化。数据格式五花八门、评测基准各自为政、硬件适配反复造轮子——这些工程层面的摩擦,常常消耗掉研究者大量本应投入算法创新的精力。

Dexbotic 2.0的应对策略是:从"数据—训练—评测—硬件"四个环节系统性地构建闭环。

数据处理方面,Dexbotic提出了DexData统一数据格式,将Prompt、子任务拆解、目标物体框选、2D轨迹等标注信息整合于一体,极大压缩了多源异构数据对齐的工程开销。基于DexData格式,系统自动完成图像、文本及状态信息的提取与预处理,可直接用于全面的监督训练。

仿真评测方面,通过Docker环境一口气适配了5款主流仿真器,所有仿真训练数据均转化为DexData格式并全部开源于Hugging Face。不同团队可在完全相同的数据条件下进行训练和评测,从根本上解决了"复现不公平"的行业顽疾。

真机评测方面,Dexbotic打通了全球首个具身智能大规模真机评测平台RoboChallenge的评测接口代码并全面开源。研究者基于Dexbotic开发的模型,可在RoboChallenge平台进行公开、公平、透明的性能验证,从开发、训练、推理到评测,技术链路首次在基础设施层面实现了完整闭合。

硬件支持方面,DOS-W1作为原力灵机推出的首款开源硬件产品,采用完全开源设计——所有文档、BOM、设计图纸、组装方案与相关代码均已公开。大量快拆结构与符合人体工学的抗疲劳设计,显著降低了机器人使用与数据采集门槛。结合此前接入的SO-101、Galaxea R1、XLeRobot等十余款机型,Dexbotic已构建起具身智能开源社区中覆盖最广的硬件适配矩阵之一。

05.

SFT到RL一键闭环:与RLinf的"乐高式"牵手如何重塑训练范式?

在大模型领域,"SFT预训练 + RLHF后训练"已被验证为提升模型能力的黄金范式。具身智能同样遵循这一逻辑:VLA模型通过SFT学会基础的感知与操作能力,再通过大规模RL后训练持续优化真实任务中的成功率与动作质量。

但此前,这条路径的工程实现极为痛苦。

研究者先在Dexbotic完成模型开发与SFT训练,拿到Checkpoint后不得不切换到RLinf仓库,借助外部入口脚本启动RL任务。这种方式对RLinf原生模型并不构成障碍,但对Dexbotic用户而言痛点显而易见:模型连接、Checkpoint路径、适配器与任务配置都要迁移至外部入口;两个项目之间存在认知割裂;每新增一个Dexbotic策略都可能牵动RLinf内部改动;SFT与RL被人为切割成了两条互不相通的流水线。

作为Dexbotic与RLinf战略合作的阶段性成果,这一局面已被彻底改写。Dexbotic正式支持以RLinf作为其分布式强化学习后端,开发者只需停留在Dexbotic项目内,一行命令即可启动完整的RL后训练流程。从模型开发、SFT Checkpoint管理,到RL配置编写与任务启动,所有环节一站式完成,启动命令简洁到近乎"零门槛"。

这次整合最值得称道的,是其"乐高式"的协作架构。Dexbotic继续深耕策略定义、模型注册、Checkpoint管理、模型专属数据变换与用户侧实验入口;RLinf稳守后端本职,承担分布式Rollout、优化、Worker调度、日志记录与Runner编排。两个项目通过标准化的后端适配器衔接,没有Fork、没有代码融合,如乐高积木般模块化拼装、各自独立演进。RLinf的版本迭代不会打断Dexbotic的用户体验,Dexbotic的策略扩展也不会反向侵入RLinf内部逻辑。这种架构的开源价值尤为珍贵:团队无需改造RLinf主训练循环,也无需将两份codebase强行揉合,从根本上降低了长期维护成本。

与此同时,Dexbotic还引入了基于GRPO的轻量级后训练方案作为补充——不依赖Ray、支持多卡并行推理、训练数据点对点均匀分配,对资源有限的团队尤其友好。两条RL路径一重一轻、互为补充,让不同规模的团队都能找到适合自己的后训练通道。

06.

谁在定义具身智能的"PyTorch时刻"?

从V-L-A模块化解耦到DexData统一数据格式,从多源数据混合训练到SFT+RL一键闭环,从5款仿真器适配到10余款真机硬件覆盖,从DM0登顶全球到UniNaVid导航链路打通,从CogACT端到端联合优化到GR00T N1在LIBERO上跑出94.8的均分——Dexbotic正沿着PyTorch当年走过的路径,一步步构建起具身智能领域的底层共识。

当然,一个时代级的基础设施不会由某一个项目单独定义。Dexbotic能否真正成长为具身智能的底层运行层,最终取决于它能为多少研究者降低门槛、为多少团队加速迭代、为多少创新想法提供落地的土壤。

半年时间,数十家顶尖机构,超千位研发者,15+核心Feature迭代。

这份答卷虽然还在书写的过程中,但方向已经愈发清晰——具身智能的"PyTorch时刻",或许正在到来。