2026年,具身智能赛道迎来数据井喷之年。仿真数据、视频数据、多模态数据层出不穷,行业似乎进入“喂数据就能进化”的快车道。然而,热闹的浪潮之下,真正能解锁精细操作的关键数据——触觉,依然稀缺。

在这轮数据竞赛中,一家专注于触觉领域的企业,戴盟机器人以黑马之姿脱颖而出。

4月15日,戴盟机器人联合Google DeepMind、中国移动、新加坡国立大学、香港科技大学、上海交通大学、日本东北大学等海内外数十家顶尖学术机构与知名企业,发布全球最大规模含触觉全模态物理世界数据集Daimon-Infinity,计划年内扩展至数百万小时,其中10000小时数据面向全行业开放共享,首批1000小时已在阿里魔搭社区上线。

当行业仍在用视频数据训练机器人时,戴盟试图用触觉回答一个根本问题:机器人如何真正“感知”物理世界?

01.

触觉数据为何是“精细操作的最后一块拼图”?

在戴盟的Daimon-Infinity发布之前,具身智能的训练数据困境已是行业公开的焦虑。一方面,行业对数据的需求极为迫切;另一方面,现有数据采集方式效率低、成本高,数据产出极为有限。

更深层的问题是,具身智能所需的数据并不只是看和说,而是在真实物理世界中完成接触、施力、协同与失败的全过程记录。这就引出了一个关键疑问:仅有视觉数据,机器人真的能学会精细操作吗?

“我们不仅使用眼睛,也拥有触觉,而机器人目前只有‘眼睛’,因此它们需要具备触觉能力。”英伟达CEO黄仁勋在2026年CES展会上表示。在他看来,精细操作技能的实现极为困难,而触觉正是补齐这一短板的关键。

拧瓶盖需要感知拧紧过程的阻力变化,抓衣服需要感知形变程度来调整握力,轴孔装配需要感知微米级的力反馈,这些操作的决定性信息来自触觉,而非视觉。纯视觉模型无论看多少数据,都无法从像素中推断出“拧紧了”还是“没拧紧”。

视觉可以告诉你物体在哪里,但只有触觉能告诉你接触时的物理交互信息——而这正是精细操作的底层逻辑。

这一认识正在成为行业共识。中国工程院外籍院士张建伟指出,具身智能的核心优势在于通过视觉、语言、触觉、运动、感知等多模态技术和材料、形体以及环境的交互深度融合,让机器从被动的感知走向主动的理解和自主的决策。VLA模型也正在向含触觉的VTLA演进,以突破信息融合的技术瓶颈。

02.

全球最大规模含触觉全模态物理世界数据集Daimon-Infinity

精细操作的本质是“在接触中控制力”,而视觉只能看到位置和姿态,无法感知力、形变和滑移。戴盟的VTLA架构正是将触觉作为与视觉并列的第四模态,以填补这一根本缺口。

戴盟机器人这次发布的Daimon-Infinity数据集有两大突破。

一是,Daimon-Infinity 以 “百万小时” 为起点,打造了全球规模最大的全模态物理世界具身数据集。

按照规划,数据集年内将扩展至数百万小时、近十亿条具身数据,远超行业现有数据集规模,为具身智能模型训练提供了前所未有的数据体量支撑。值得注意的是,这一海量数据的采集能力来自全球最大规模的外发式具身数据采集网络。这种采集模式突破了传统数据采集厂的限制,可以进入各类不同的真实复杂场景中采集数据——真实世界为具身智能提供了源源不断的素材;同时,这种方式采集到的数据也更加真实,能够满足具身智能提升泛化能力的需求。

二是行业最高标准的全模态触觉数据。

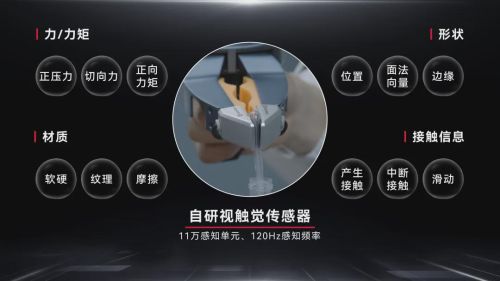

具体而言,Daimon-Infinity数据集依托戴盟自研的二指夹爪及五指手套数据采集设备,搭载了含11万感知单元、120Hz高分辨率视触觉传感器,配合高清鱼眼相机、IMU、双目相机等,能够同步采集触觉、视觉、动作轨迹、执行动作、文本指令等全维度信息。

更重要的是,Daimon-Infinity 数据集包含了接触力、接触形变、接触状态,及物体材质与形貌、接触滑移、表面纹理等高密度全模态触觉信息,相较于行业,将触觉数据推进到了更高维度为精细操作补全稀缺的物理交互特征。这也是目前行业内分辨率最高、信息最完整的触觉具身数据。DeepMind、中国移动、海内外高校等顶尖机构选择与戴盟合作、共建Daimon-Infinity数据集,也体现了行业内对于触觉数据价值的共识一一触觉感知己经不是高端选配,而将成为具身智能的必选项。

值得一提的是,戴盟还搭建了全链路数据处理引擎,为Daimon-Infinity提供从物理交互到数字世界的全流程质量保障。通过软硬件协同,前端采集源头实现毫秒级对齐;通过高效编码压缩及序列化压缩,保持数据精度的同时,最小化数据存储成本。数据处理管线可从采集的原始数据中提取出接触形貌、三维形变场、三维分布力以及六维集中力等十多种触觉模态,将真实世界的交互表征嵌入到每一帧的数据中。这种全链路能力意味着,数据不再是零散的“原材料”,而是经过精细加工的“生产资料”。

从验证结果来看,模型在Daimon-Infinity具身数据上进行预训练后,只需约十分之一的数据量,即可在轴孔装配、污痕擦拭等多项精细操作任务中达到更优的成功率,训练效率实现10倍的跨越式提升。据戴盟透露,在一些接触密集或接触关键的任务上,触觉数据的引入甚至实现了从50%到100%的跳跃式提升。

03.

开源共建:戴盟的生态野望

更具行业意义的是,Daimon-Infinity选择开源10000小时数据。这个决策背后,是戴盟对行业格局的清晰判断。

戴盟的生态路径鲜明。它没有“闭门造车”,而是以数据为杠杆撬动整个生态,开源数据集吸引合作者,合作者贡献数据和场景,戴盟从中迭代产品和标准。目前,戴盟已构建全球最大规模的外发式具身数据采集网络,年产数据规模可达数百万小时,覆盖工业装配、智慧物流、养老护理、家居服务、科研实验、餐饮零售及户外空间等核心场景。

而这一生态路径之所以能够跑通,根源在于戴盟在触觉领域的技术积累。戴盟以视触觉技术为壁垒,通过含触觉的多模态融合,推动具身智能的灵巧操作发展:一直以来,戴盟以视触觉硬件为入口,为具身智能引入高质量的触觉感知;现在发布数据集,则是因为其看到了含触觉数据对于模型迭代的重要性。正是基于这些长期积累,戴盟的开源策略才有了独特的底气与方向。

而开源数据的意图并不复杂:让更多模型厂商用起来,共同验证触觉的有效性,推动行业形成共识;也让更多开发者接触含触觉的数据,加速突破落地瓶颈。

04.

结语

Daimon-Infinity的发布,伴随着具身智能行业正经历的一场根本性的范式转移。

过去,行业的焦点是“让机器人看到世界”;现在,我们开始追问“让机器人感知世界”。视觉告诉机器人是什么,触觉告诉机器人“怎么样”——力有多大、形变多深。 在精细操作这一具身智能的终极考卷上,触觉是解题的关键变量。

戴盟的这场大规模开源,价值不仅在于数据的规模和质量,更在于它开启了一条共建共享的生态路径。在行业数据稀缺、孤岛林立的当下,戴盟主动打破围墙、开放核心资产。

具身智能真正的“涌现智能”临界点尚未到来,但触觉数据的加入,正在让这个临界点变得更近、更可触及。在通往通用具身智能的道路上,触觉不再是锦上添花的“备选感知”,而正在成为通往真实物理世界理解力的必经之路。